Categoría: Inteligencia Artificial

-

⚙️ La integración entre agentes LLM y herramientas DevOps ya no es ciencia ficción.

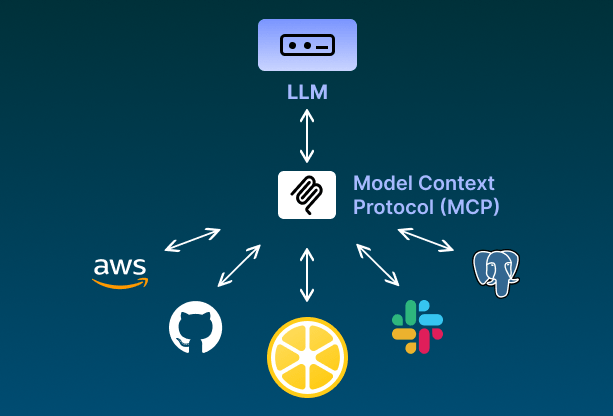

Los servidores MCP (Model Context Protocol) permiten que agentes de lenguaje natural interactúen directamente con herramientas clave de infraestructura, automatización y monitoreo. Esto habilita flujos de trabajo más inteligentes, donde la IA no solo te sugiere… también actúa. 💡 Algunos servidores MCP que ya podés usar hoy mismo: 🔷 AWS MCP: controlá servicios de Amazon…

-

🧠 LangChain lanza un potente constructor de agentes de IA de código abierto

LangChain presentó su nuevo constructor de agentes de IA open source, una herramienta que permite a desarrolladores crear, personalizar y ejecutar agentes inteligentes directamente en sus entornos locales, sin depender de plataformas cerradas o servicios en la nube. Este constructor está basado en YAML y permite definir agentes paso a paso, conectarlos con herramientas como…

-

🚀 Xiaomi entra de lleno en la carrera de la inteligencia artificial con MiMo, su propio modelo de lenguaje de código abierto.

MiMo 7B es el nuevo modelo de lenguaje creado por Xiaomi, con 7.000 millones de parámetros, diseñado para competir directamente con los grandes como ChatGPT, Gemini y Claude. Lo más destacado: su enfoque en el razonamiento lógico y matemático, donde ya ha superado a varios modelos de mayor tamaño en benchmarks clave. 📊 Este modelo…

-

🤖 Amazon lanza Nova Premier: su modelo de inteligencia artificial más avanzado

Amazon ha presentado oficialmente Nova Premier, el modelo de inteligencia artificial más potente de su familia Nova. Diseñado para afrontar tareas complejas, se destaca por su capacidad multimodal, lo que le permite procesar texto, imágenes y vídeos con un nivel de comprensión profundo y contextual. Uno de los aspectos más sobresalientes de este modelo es…

-

🤖 Meta AI se independiza: ahora disponible como app autónoma con capacidades avanzadas de voz

Meta ha lanzado oficialmente su asistente de inteligencia artificial, Meta AI, como una aplicación independiente. Esta nueva app, impulsada por el modelo de lenguaje Llama 4, ofrece una experiencia más personalizada y conversacional, destacándose por sus avanzadas capacidades de interacción por voz y un enfoque social innovador . Entre las características más destacadas se encuentran:…

-

Alibaba presenta Qwen 3: una nueva referencia en inteligencia artificial de código abierto 🤖🌍

Alibaba ha anunciado el lanzamiento de Qwen 3, una ambiciosa y avanzada familia de modelos de inteligencia artificial que abarca desde versiones ligeras hasta un modelo Mixture of Experts (MoE) con 235 mil millones de parámetros. Este desarrollo está disponible bajo una licencia Apache 2.0, lo que refuerza el compromiso de la compañía con la…

-

Google lanza Agent2Agent

El protocolo que conecta agentes de IA. Google presentó Agent2Agent (A2A), un protocolo abierto diseñado para que los agentes de inteligencia artificial (IA) intercambien información y coordinen acciones, incluso si fueron desarrollados por diferentes empresas o tecnologías. A diferencia de los sistemas de automatización tradicionales, estos agentes son capaces de adaptarse dinámicamente y tomar decisiones…

-

OpenAI O3 y O4: Un salto hacia la IA autónoma y multimodal

OpenAI ha presentado sus nuevos modelos O3 y O4, marcando un avance significativo en el campo de la inteligencia artificial. Estos modelos combinan capacidades de procesamiento de texto e imágenes , permitiendo un razonamiento más preciso y respuestas más naturales. La capacidad de comprender el contenido visual y utilizarlo en el razonamiento representa una mejora…

-

MCP en GitHub

Una nueva forma de integrar IA al desarrollo. El servidor MCP (Model Context Protocol) en GitHub es una herramienta innovadora que permite a los desarrolladores mejorar su flujo de trabajo mediante la integración de inteligencia artificial. Este protocolo estandarizado facilita la automatización de tareas, la gestión eficiente de repositorios y la incorporación de funciones avanzadas…

-

🚀 Google lanzó el Agent Development Kit (ADK)

El Agent Development Kit es un conjunto de herramientas de código abierto diseñado para facilitar la creación de agentes de inteligencia artificial. Además, ofrece un catálogo de agentes listos para usar en su plataforma de computación en la nube. Con esta propuesta, Google promete que los desarrolladores podrán construir un agente de IA en menos…